Konsistenz der Charaktere: Meisterhafte KI-Bilderzeugung für das Geschichtenerzählen im Jahr 2026!

Warum dies wichtig ist: Für Autoren, die visuelle Erzählungen, Marketingkampagnen oder Spiele entwickeln, ist die Konsistenz der Charaktere der Unterschied zwischen amateurhaftem Output und professionellem Storytelling. Dieser umfassende Leitfaden zeigt die technische Architektur, bewährte Arbeitsabläufe und modernste Tools, die KI-generierte Charaktere von zufälligen Variationen in zuverlässige, wiedererkennbare Identitäten über mehrere Bilder und Szenen hinweg verwandeln.

Was ist Zeichenkonsistenz und warum sollten Sie darauf achten?

Die Konsistenz von Figuren bei der KI-Bilderstellung bedeutet, dass Gesichtszüge, Körperstruktur, Kleidung und visuelle Identität über mehrere Ausgaben hinweg identisch bleiben. Wenn Sie ein Bild einer Figur generieren, stellt die Konsistenz sicher, dass dieselbe Figur auf den nächsten 100 Bildern wiedererkennbar ist – unabhängig von Änderungen der Pose, der Beleuchtung oder des Hintergrunds.

Die zentrale Herausforderung: Traditionelle KI-Modelle wie DALL-E von OpenAI oder frühe Versionen von Stable Diffusion arbeiten ohne Speicher. Jede Eingabeaufforderung führt zu einer einzigartigen Interpretation, was es nahezu unmöglich macht, dieselbe Person zweimal zu erzeugen. Diese Einschränkung hat in der Vergangenheit verhindert, dass KI für sequentielles Storytelling, Markenmaskottchen oder kohärente visuelle Kampagnen eingesetzt werden konnte.

Im Jahr 2026 gibt es für dieses Problem mehrere Lösungen. Tools bieten jetzt durch Referenzsysteme, Identitätsadapter und Feinabstimmungstechniken eine konsistente Figur. Welche Methode für Ihren Arbeitsablauf geeignet ist, entscheidet darüber, ob Sie 5 Minuten oder 5 Stunden für die Aufrechterhaltung der visuellen Kohärenz benötigen.

Wichtige Hinweise: Wesentlicher Informationsgewinn

Sofortige Konsistenz vs. Trainingsinvestitionen: Referenzbasierte Systeme (Midjourney --cref OpenArt Character) liefern sofortige Ergebnisse, bieten aber weniger Kontrolle als geschulte LoRAs. Entscheiden Sie sich je nach Projektumfang – schnelle Experimente bevorzugen Referenzen, während langfristige Asset-Bibliotheken den Schulungsaufwand rechtfertigen.

Hierarchie der Identitätsadapter: InstantID zeichnet sich durch Gesichtstreue und realistische Stile aus, IP-Adapter bietet eine bessere Textkontrolle und abstrakte Stilübertragungen, LoRA-Training bietet maximale Konsistenz, erfordert jedoch eine vorherige Datensatzvorbereitung. Die optimale Wahl hängt von den spezifischen Anforderungen des Anwendungsfalls ab.

Komplexität bei mehreren Zeichen: Die Generierung von Szenen mit 2 konsistenten Zeichen erhöht den Schwierigkeitsgrad exponentiell. Individuelle LoRAs mit sorgfältiger Prompt-Gewichtung liefern die zuverlässigsten Ergebnisse, obwohl regionales Prompting und Inpainting Ausweichlösungen für komplexe Kompositionen bieten.

Technische Beschränkungen bleiben bestehen: Feine Details (Sommersprossen, kleine Tätowierungen, Logos), extreme Posen mit Okklusion und dramatische Stilübertragungen bleiben eine Herausforderung. Abhilfe schaffen detaillierte Eingabeaufforderungen, zweistufige Generierungsprozesse und eine sorgfältige Referenzauswahl, um diese Einschränkungen zu minimieren.

Wie erzeugen moderne KI-Tools konsistente Charaktere?

Die technische Grundlage der Zeichenkonsistenz beruht auf drei verschiedenen Ansätzen: referenzbasierte Systeme, identitätserhaltende Adapter und Modellfeinabstimmung. Jede Methode bietet unterschiedliche Kompromisse zwischen Geschwindigkeit, Wiedergabetreue und Flexibilität.

Referenz-basierte Systeme: Die schnelle Lösung

Plattformen wie Midjourney V7 führten Omni-Reference ein , das den Parameter --cref gefolgt von einer Bild-URL verwendet. Dieses System analysiert Gesichtszüge, Haare und Kleidung aus einem Referenzbild und wendet diese Merkmale dann auf neue Generationen an. Die Dokumentation von Midjourney gibt an, daß die Zeichengewichtung(--cw) von 0 bis 100 reicht, wobei höhere Werte mehr Details der Referenz erhalten.

OpenArt hat sich im Jahr 2025 durch seine Vielseitigkeit in verschiedenen Kunststilen hervorgetan. Mit der Charakterfunktion können Ersteller benutzerdefinierte Charakterprofile speichern, die sich die KI über mehrere Sitzungen hinweg merkt. Unabhängige Tests zeigten, dass OpenArt nahezu perfekte Ergebnisse bei der konsistenten Charaktererstellung in realistischen, Anime-, Carto- und Ölmalerei-Stilen erzielt.

Adapter zur Identitätserhaltung: Technische Präzision

InstantID revolutioniert die Identitätssicherung durch die Einführung eines Plug-and-Play-Moduls, das mit Stable Diffusion-Modellen arbeitet. Laut der in arXiv veröffentlichten Forschung verwendet InstantID drei Komponenten: Gesichts-ID-Einbettungen aus Erkennungsmodellen, ein leichtgewichtiges, angepasstes Modul mit entkoppelter Cross-Attention und ein IdentityNet, das detaillierte Gesichtsmerkmale mit räumlicher Kontrolle kodiert.

Der entscheidende Vorteil: InstantID bewahrt die Gesichtsidentität aus einem einzigen Referenzbild, ohne dass eine Anpassung zur Testzeit erforderlich ist. Das System zeigte im Vergleich zu IP-Adapter-FaceID eine höhere Wiedergabetreue beim Überblenden von Gesichtern mit Hintergründen, insbesondere bei nicht realistischen Stilen wie Anime.

IP-Adapter stellt einen anderen Ansatz dar, der Cross-Attention-Mechanismen zur Trennung von Text- und Bildmerkmalen verwendet. Obwohl er für die grundlegende Konsistenz effektiv ist, erzeugt seine Abhängigkeit von CLIP-Bild-Encodern im Vergleich zu gesichtsspezifischen Encodern schwächere Signale. Dieser Kompromiss kommt Schöpfern zugute, die der Textkontrolle den Vorzug vor absoluter Gesichtstreue geben.

Modell-Feinabstimmung: Maximale Kontrolle

Das LoRA-Training (Low-Rank Adaptation) bietet die stärkste Zeichenkonsistenz bei wiederholter Verwendung. Bei dieser Technik werden Stable Diffusion-Modelle durch Hinzufügen kleiner trainierbarer Parameter feinabgestimmt, während das Basismodell eingefroren bleibt. Nach Angaben von Stable Diffusion Art bleiben LoRA-Dateien im Vergleich zu vollständigen Modell-Checkpoints (2-4 GB) kompakt (typischerweise 10-200 MB), was sie für Ersteller, die mehrere Charaktere verwalten, praktisch macht.

Für das Training sind 15-30 qualitativ hochwertige Bilder erforderlich, die verschiedene Posen, Ausdrücke und Blickwinkel zeigen. Forschungen von Everly Heights haben gezeigt, dass Charakterbögen – Einzelbilder mit mehreren Posen – geteilt und verarbeitet werden können, um robuste Trainingsdatensätze aus minimalem Quellmaterial zu erstellen. Der Trainingsprozess dauert in der Regel 1-2 Stunden auf einer RTX 4090 oder 3-5 Stunden auf einer RTX 3070.

Welche Plattform bietet im Jahr 2026 perfekte Zeichenkonsistenz?

Unterschiedliche Entwickler brauchen unterschiedliche Werkzeuge. Spieleentwickler, die Asset-Bibliotheken erstellen, haben andere Anforderungen als Autoren, die Kinderbücher illustrieren, oder Marketingfachleute, die Kampagnenvisualisierungen erstellen.

Für stilübergreifende Vielseitigkeit: OpenArt

Die Charakterfunktion von OpenArt eignet sich hervorragend für Projekte, bei denen ein und dieselbe Figur in völlig unterschiedlichen Stilen benötigt wird. Ein einziges Charakterprofil funktioniert nahtlos über fotorealistische, Anime-, Carto- und Malstile hinweg und behält dabei seine Identität. Die Benutzeroberfläche der Plattform ist besonders benutzerfreundlich: Der Ersteller muss die Figur nur einmal beschreiben, und die KI generiert ohne manuelle Anpassungen Variationen für jede Szene oder jeden Stil.

Für Cartoon und illustrierte Charaktere: Neolemon

Neolemon konzentriert sich ausschließlich auf illustrierte Stile und bedient über 20.000 Ersteller, darunter Self-Publishing-Autoren und Pädagogen. Nach Mitte 2025 stellte die Plattform die fotorealistische Ausgabe ein, um sich auf Cartoons, Pixar-Qualität und 2D-Illustrationen zu konzentrieren. Die integrierte Suite umfasst eine strukturierte Eingabeaufforderung, die die Beschreibung des Charakters (Aussehen, Outfit) von der Beschreibung der Szene (Handlung, Hintergrund, Kunststil) trennt und eine präzise Kontrolle der Konsistenz ermöglicht.

Für tiefe Identitätskontrolle: InstantID und IP-Adapter

Technische Entwickler, die ComfyUI oder AUTOMATIC1111 verwenden, erhalten durch InstantID- und IP-Adapter-Implementierungen maximale Kontrolle. Diese Systeme lassen sich in bestehende Stable Diffusion-Workflows integrieren und ermöglichen eine präzise Parameterabstimmung für bestimmte Anwendungsfälle. Laut der InstantID-Dokumentation erzielt das System wettbewerbsfähige Ergebnisse mit vortrainierten LoRAs ohne jegliche Schulung und ist damit ideal für Rapid Prototyping.

Für professionelle Arbeitsabläufe: LoRA-Schulung

Studios und Agenturen, die Hunderte von konsistenten Assets benötigen, sollten in LoRA-Schulungen investieren. Die im Vorfeld getätigte Zeitinvestition (Datensatzvorbereitung, Training, Testen) zahlt sich durch unbegrenzte Generierungsflexibilität aus. Untersuchungen von PropelRC haben ergeben, dass richtig trainierte LoRAs selbst in Grenzfällen wie extremen Posen, ungewöhnlichen Lichtverhältnissen oder komplexen Umgebungen perfekte Charakterkonsistenz gewährleisten.

Wie kann ich die Konsistenz des Charakters über verschiedene Posen hinweg aufrechterhalten?

Posenvariationen sind der häufigste Fehler bei der Konsistenz von Figuren. Eine Figur, die in Frontalporträts identisch aussieht, ist in Profil- oder Dreiviertelansichten oft nicht wiederzuerkennen.

Die technische Lösung: ControlNet-Integration

ControlNet fügt der Bilderzeugung eine strukturelle Führung hinzu, indem es die räumlichen Informationen von Referenzbildern bewahrt. In Kombination mit Identitätssicherungen wie InstantID fixiert ControlNet die Körperposition, während der Identitätsadapter die Gesichtszüge beibehält. Dieser Ansatz der doppelten Kontrolle ermöglicht die Erstellung konsistenter Charaktere in jeder Pose.

OpenPose, ein spezielles ControlNet-Modell, extrahiert die Skelettstruktur aus Referenzbildern. Laut der Skywork AI-Forschung führt die Kombination von OpenPose mit dem IP-Adapter FaceID Plus v2 bei 20-30 Schritten und CFG 5-9 zu zuverlässigen Ergebnissen für die meisten Posenvariationen. Für SDXL-Modelle umfasst der empfohlene Arbeitsablauf das Laden des Basismodells in models/Stable-diffusion, die Installation der ControlNet-Erweiterung und die Einstellung der IP-Adapter-Stärke zwischen 0,6-0,8.

Praktischer Arbeitsablauf für verschiedene Posen

Der effizienteste Arbeitsablauf für Posenvariationen beginnt mit der Erstellung einer Basisfigur in einer neutralen, nach vorne gerichteten Position. Dieses Bild dient als Referenzanker. Für jede neue Pose:

- Erstellen Sie eine grobe Skizze oder verwenden Sie ein Referenzfoto, das die gewünschte Körperposition zeigt

- Wenden Sie OpenPose ControlNet an, um die Skelettstruktur zu extrahieren

- Verwenden Sie InstantID oder IP-Adapter mit der ursprünglichen Zeichenreferenz

- Passen Sie die Stärke des Adapters an (typischerweise 0,6-0,7), um ein Gleichgewicht zwischen Konsistenz und Flexibilität der Pose herzustellen

- Erzeugen Sie mehrere Variationen und wählen Sie das beste Ergebnis aus

Bei diesem Arbeitsablauf bleiben Gesichtszüge, Körperproportionen und Outfitdetails erhalten, während Ganzkörperposen, Actionszenen oder dynamische Kompositionen möglich sind.

Was sind die besten Prompts für konsistente Charakter-KI?

DieErstellung von Prompts ist auch bei der Verwendung fortschrittlicher Konsistenz-Tools entscheidend. Gut strukturierte Prompts bieten der KI klare Grenzen und spezifische Details, die die visuelle Konsistenz unterstützen.

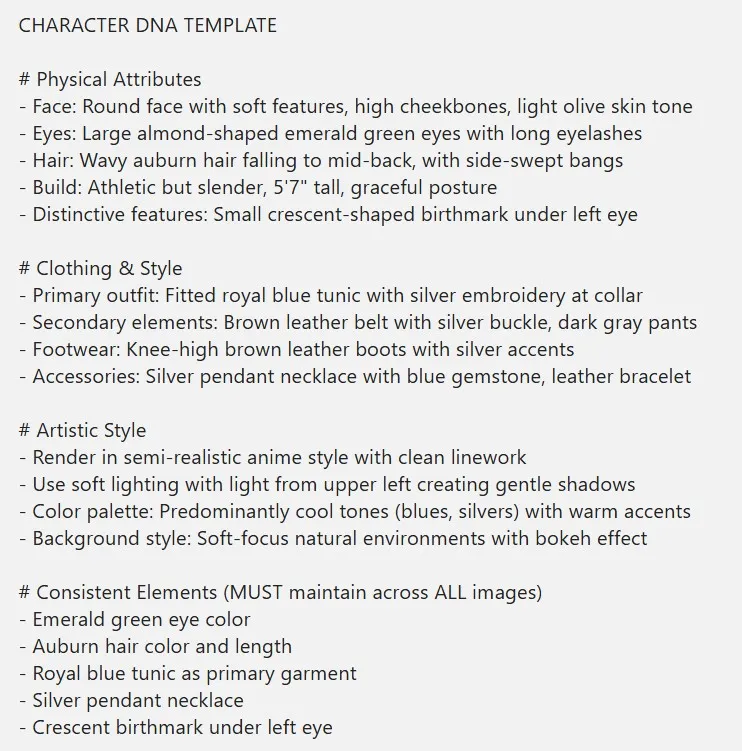

Die DNA-Schablonen-Methode

ChatGPT-Nutzer profitieren von der Erstellung umfassender “DNA-Vorlagen” für Charaktere. Laut der KI-Forschung von LaoZhang umfassen effektive Vorlagen: physische Attribute (Alter, Größe, Körperbau, charakteristische Merkmale), Gesichtsdetails (Augenfarbe, -form, -abstand, Nasenstruktur, Mundform, Kieferlinie), Haarspezifikationen (Farbe, Länge, Textur, Stil) und charakteristische Kleidung (bestimmte Kleidungsstücke, Farben, Accessoires, Stilhinweise).

Eine vollständige DNA-Vorlage könnte so aussehen:

“Maya, 28-jährige Latina, 1,70 m groß, athletische Statur, ovales Gesicht mit hohen Wangenknochen, mandelförmige dunkelbraune Augen, leicht nach oben gebogene Nase, volle Lippen, ausgeprägte Kieferpartie, gewelltes schwarzes Haar, das bis zur Mitte des Rückens reicht und normalerweise einen Pferdeschwanz trägt, olivfarbener Hautton, trug eine marineblaue Sportjacke mit weißen Streifen, schwarze Leggings und weiße Laufschuhe.”

Diese detaillierte Grundlage ermöglicht es der KI, mehrere Variationen zu generieren und dabei die wichtigsten Identitätsmerkmale beizubehalten. Die Vorlage sollte in jeder neuen Eingabeaufforderung wortwörtlich referenziert werden, wobei sich nur szenenspezifische Details ändern.

Strukturierte Prompt-Architektur

Die effektivsten Prompts trennen die Charakteridentität von der Szenenbeschreibung durch eine hierarchische Struktur:

Block “Identität der Figur” (bleibt konstant): “Maya, 28-jährige Latina, athletische Statur, gewellter schwarzer Pferdeschwanz, marineblaue Sportjacke”

Variabler Block der Szene (ändert sich pro Bild): “Laufen durch einen Stadtpark bei Sonnenaufgang, Bewegungsunschärfe im Hintergrund, filmische Beleuchtung, Weitwinkelaufnahme”

Stil-Spezifikationsblock: “fotorealistisch, sehr detailliert, professionelle Fotografie, 35-mm-Objektiv, geringe Schärfentiefe”

Diese Architektur ermöglicht es, perfekte Konsistenz zu wahren und gleichzeitig unbegrenzte Szenarien zu erkunden. Der einheitliche Identitätsblock sorgt für Wiedererkennung über alle Bilder hinweg, während variable Blöcke kreative Flexibilität bieten.

Wie behandle ich die Zeichenkonsistenz für mehrere Zeichen?

Szenen mit mehreren Charakteren stellen eine exponentielle Komplexität dar. Jede Figur erfordert individuelle Konsistenz sowie kompositorische Kohärenz zwischen den Figuren.

Individueller LoRA-Ansatz

Die zuverlässigste Methode trainiert separate LoRAs für jeden Charakter und kombiniert sie dann während der Generierung. Nach der Apatero-Forschung steuert die LoRA-Stärke den individuellen Einfluss (typischerweise 0,5-0,8 pro Charakter). Mehrere LoRAs arbeiten zusammen, wenn sie richtig ausbalanciert sind, und ermöglichen komplexe Szenen mit 3-5 konsistenten Charakteren.

Der Arbeitsablauf erfordert:

- Trainieren einzelner LoRAs mit eindeutigen Auslösewörtern (z. B. “maya_athlete”, “carlos_scientist”)

- Testen Sie jedes LoRA unabhängig, um die Konsistenz zu überprüfen

- Kombinieren Sie die Prompts mit einer gewichteten Syntax: “(maya_athlete:0.7) und (carlos_scientist:0.6) trinken Kaffee in einem modernen Cafe”

- Passen Sie die Gewichtung an, um zu verhindern, dass ein Zeichen die Komposition dominiert

- Verwendung von regionalem Prompting oder Inpainting zur Verfeinerung der Platzierung einzelner Zeichen

Referenzbildverkettung

Für Plattformen wie Midjourney können mehrere Referenz-URLs aneinandergereiht werden: – -cref URL1 URL2 URL3. Auf diese Weise werden Zeicheninformationen aus mehreren Bildern zusammengeführt. Untersuchungen von Geeky Curiosity zeigen, dass die Reihenfolge der URLs die Gewichtung beeinflusst – frühere URLs erhalten einen stärkeren Einfluss.

Bei Szenen mit zwei Zeichen werden durch die Verwendung von --cref Zeichen1_url Zeichen2_url mit entsprechender Zeichengewichtung(--cw 80-100) beide Identitäten beibehalten. Komplexere Szenen erfordern eine sorgfältige Planung der Eingabeaufforderung, um festzulegen, welches Zeichen welche Position in der Komposition einnimmt.

Welche technischen Herausforderungen beeinträchtigen noch die Zeichenkonsistenz?

Trotz des rasanten Fortschritts gibt es auch im Jahr 2026 noch einige technische Einschränkungen. Das Verständnis dieser Einschränkungen hilft den Entwicklern, realistische Erwartungen zu setzen und effektive Lösungen zu entwickeln.

Bewahrung feiner Details

Aktuelle Systeme haben Probleme mit winzigen Details wie spezifischen Sommersprossenmustern, kleinen Tattoos, Schmuckgravuren oder Markenlogos auf Kleidung. Laut der Midjourney-Dokumentation weist der Parameter --cref ausdrücklich auf die Einschränkungen beim Kopieren von exakten Grübchen, Sommersprossen oder T-Shirt-Logos hin.

Umgehung: Fügen Sie kritische Details in die Eingabeaufforderungen ein, anstatt sich auf die Erfassung von Referenzbildern zu verlassen. Wenn ein Charakter eine markante Narbe über der linken Augenbraue hat, geben Sie in jeder Eingabeaufforderung “thin vertical scar above left eyebrow” an.

Stilübertragung Identitätsverlust

Die Umwandlung einer fotorealistischen Figur in einen Anime- oder Cartoon-Stil unter Beibehaltung der Identität ist eine Herausforderung. IP-Adapter schneidet bei drastischen Stiländerungen besser ab als InstantID, da seine CLIP-basierte Einbettung abstraktere geometrische Invarianten erfasst. Untersuchungen von Alibaba Product Insights zeigen, dass IP-Adapter bei Stilübertragungen einen mittleren Ähnlichkeitswert von 0,74 gegenüber 0,66 bei InstantID erreicht.

Umgehung: Generieren Sie das Zeichen zunächst im Zielstil und verwenden Sie dann diese stilisierte Version als Referenz für nachfolgende Bilder. Dieser Ansatz wahrt die Konsistenz innerhalb der gewählten Ästhetik und kämpft nicht mit den Einschränkungen der Stilübertragung.

Extreme Pose und Okklusionsfehler

Zeichen, die teilweise von Objekten verdeckt werden, extrem verkürzt sind oder stark verdeckt sind, verlieren oft an Konsistenz. Der KI fehlt es an vollständigen visuellen Informationen und sie füllt Lücken mit statistischen Annahmen, die von der etablierten Identität abweichen.

Abhilfe: Generieren Sie verdeckte Bilder in einem zweistufigen Verfahren. Erstellen Sie zunächst die Figur in einer ähnlichen unverdeckten Pose. Dann fügen Sie mit Inpaint verdeckende Elemente hinzu, während die sichtbaren Teile der Figur erhalten bleiben. Mit dieser Technik bleibt die Figur über die gesamte kompositorische Komplexität hinweg erhalten.

Beleuchtung und Ausdrucksverschränkung

Mit InstantID und ähnlichen Tools werden manchmal Beleuchtungsbedingungen oder Gesichtsausdrücke mit der Kernidentität verwoben. Eine Charakterreferenz, die eine starke seitliche Beleuchtung aufweist, kann Generationen hervorbringen, die die Beleuchtungsmerkmale zusammen mit den Gesichtszügen erben, was die kompositorische Flexibilität einschränkt.

Abhilfe: Verwenden Sie gleichmäßig beleuchtete Referenzen mit neutralem Ausdruck, um maximale Flexibilität bei der Generierung zu erreichen. Speichern Sie ausdrucksstark beleuchtete oder emotional aufgeladene Referenzbilder für spezielle Anwendungsfälle, die diesen Bedingungen entsprechen.

Wie kann Storytelling von perfekter Zeichenkonsistenz profitieren?

Visuelles Storytelling verändert sich, wenn Charaktere szenenübergreifend ihre Identität behalten. Die kreativen Anwendungen sind branchen- und anwendungsübergreifend, von unabhängigen Kreativen bis hin zu Unternehmenskampagnen.

Sequentielle Erzählungen und Comics

Web-Comics, Graphic Novels und sequenzielle Kunst erforderten in der Vergangenheit manuelle Illustrationen, um die Konsistenz der Figuren zu gewährleisten. Mit Hilfe von KI-Tools können nun auch Einzelautoren professionelle serielle Inhalte produzieren. Laut dem von Neolemon gesammelten Benutzer-Feedback berichten Self-Publishing-Autoren, dass sie die Zeit für die Illustration von Figuren von Wochen auf Stunden reduzieren konnten und dabei eine perfekte Kontinuität beibehalten haben.

Der Arbeitsablauf bei der Erstellung von Comics umfasst in der Regel Folgendes:

- Entwerfen der Hauptcharaktere mit Hilfe von detaillierten Anleitungen oder LoRA-Training

- Generieren von Charakterbögen mit verschiedenen Ausdrücken und Blickwinkeln

- Erstellen Sie Szenenhintergründe separat für maximale Kontrolle

- Komposition der endgültigen Panels unter Verwendung konsistenter Charakterreferenzen mit unterschiedlichen Hintergründen

- Verwenden Sie Inpaint für Sprechblasen und Textintegration

Dieser modulare Ansatz ermöglicht es den Autoren, Dialoge und das Tempo zu verbessern, ohne ganze Szenen neu zu erstellen.

Marketing und Markenkampagnen

Marken, die konsistente KI-generierte Maskottchen oder Kampagnencharaktere verwenden, berichten von erheblichen Kosteneinsparungen. Laut Erfahrungsberichten zu AI Consistent Character können Marketingteams unbegrenzte Variationen aus einer einzigen Referenz generieren – verschiedene Outfits, Einstellungen, Ausdrücke – und dabei die Markenwiedererkennung beibehalten. Die traditionelle Alternative (mehrere Fotoshootings oder in Auftrag gegebene Illustrationen) kostet exponentiell mehr.

Kampagnen-Workflow:

- Erstellen eines Markencharakters, der auf die demografische Zielgruppe abgestimmt ist

- Erstellen einer Master-Bibliothek mit Posen, Ausdrücken und Szenarien

- Erstellung lokalisierter Varianten für verschiedene Märkte

- Aufrechterhaltung der Konsistenz in digitalen Anzeigen, Druckmaterialien und sozialen Inhalten

- Aktualisieren Sie die Figur saisonal, ohne die Wiedererkennung der Marke zu verlieren

Spieleentwicklung und virtuelle Umgebungen

Spielestudios nutzen konsistente Charakter-Tools für Konzeptzeichnungen, Werbematerialien und sogar In-Game-Assets. Während Echtzeit-Spiele-Engines optimierte 3D-Modelle erfordern, erfüllen KI-generierte 2D-Assets mehrere Produktionsanforderungen. Laut einer Studie der Human Academy ist die Konsistenz der Charaktere entscheidend für die Aufrechterhaltung einer kohärenten visuellen Erzählung in Spielen.

Integration in die Produktion:

- Generierung von Konzeptvarianten für Charakterdesigner

- Erstellung von Werbegrafiken, die einheitliche Charaktere in verschiedenen Szenarien zeigen

- Erstellung von Marketingmaterialien mit wiedererkennbaren Charakteridentitäten

- Entwicklung von Referenzbögen für 3D-Modellierer

- Generierung von UI-Elementen und Charakterporträts unter Wahrung der visuellen Kontinuität

Lehrinhalte und Schulungsmaterialien

Bildungsanbieter profitieren von einheitlichen Avataren, die in Kursen oder Lernmaterialien erscheinen. Die Lernenden entwickeln eine Vertrautheit mit wiederkehrenden Lehrern oder Leitfiguren, was das Engagement erhöht. Untersuchungen, die in Erfahrungsberichten von Nutzern zitiert werden, zeigen, dass eine konsistente visuelle Präsenz den Lernenden hilft, die Konzentration aufrechtzuerhalten und eine Beziehung zu den Bildungsinhalten aufzubauen.

Sind Sie bereit, diese Konsistenztechniken in die Praxis umzusetzen? Sehen Sie sich unseren Leitfaden über die besten

AI-Influencer-Generator für 2026

um Ihre virtuelle Karriere zu starten.

Was sind die ethischen Überlegungen zur Charakterkonsistenz?

Mit dem Fortschreiten der Technologie zur Zeichenkonsistenz werden ethische Überlegungen immer wichtiger. Schöpfer müssen sich mit Fragen der Identität, der Darstellung und der verantwortungsvollen Nutzung auseinandersetzen.

Replikation echter Personen

Die meisten Plattformen verbieten oder raten ausdrücklich davon ab, Werkzeuge zur Charakterkonsistenz zu verwenden, um reale Personen ohne Zustimmung zu replizieren. Die Midjourney-Dokumentation besagt, dass ihr --cref-Parameter

“ist nicht für echte Menschen/Fotos gedacht (und wird sie wahrscheinlich verzerren).”

Diese Einschränkung dient sowohl technischen als auch ethischen Zwecken – dem Schutz der Rechte am eigenen Bild und dem Umgang mit den Erwartungen der Nutzer.

Bewährte Praxis: Generieren Sie originale KI-Charaktere, anstatt zu versuchen, echte Personen nachzubilden. Holen Sie für professionelle Projekte, die bestimmte Abbildungen erfordern, entsprechende Modellfreigaben und Genehmigungen ein.

Deepfake-Prävention

Tools für die Zeichenkonsistenz haben technische Grundlagen mit der Deepfake-Technologie gemeinsam. Verantwortungsbewusste Plattformen implementieren Sicherheitsvorkehrungen, die eine böswillige Nutzung verhindern. Laut der Dokumentation zu Hugging Face von InstantID sind die Nutzer verpflichtet, “die lokalen Gesetze einzuhalten und das Tool verantwortungsvoll zu nutzen”

Verantwortung des Urhebers: Verwenden Sie Konsistenz-Tools für legitime kreative Zwecke – Geschichtenerzählen, Kunst, Bildung, Marketing. Vermeiden Sie es, betrügerische Inhalte zu erstellen oder sich als echte Personen auszugeben.

Repräsentation und Voreingenommenheit

KI-Trainingsdaten erben Verzerrungen aus dem Ausgangsmaterial. Entwickler, die unterschiedliche Charaktere erstellen, sollten aktiv die Konsistenz zwischen verschiedenen Ethnien, Altersgruppen, Körpertypen und Fähigkeiten testen. Einige Systeme schneiden bei bestimmten demografischen Merkmalen aufgrund von Ungleichgewichten in den Trainingsdaten besser ab.

Integrativer Arbeitsablauf: Generieren Sie Testreihen mit verschiedenen demografischen Variationen, identifizieren Sie Inkonsistenzen oder Qualitätsunterschiede, passen Sie Aufforderungen oder Tools an, um gerechte Ergebnisse zu erzielen, dokumentieren Sie systematische Verzerrungen und melden Sie sie den Plattformentwicklern.

Wie wird sich die Zeichenkonsistenz im Jahr 2027 und darüber hinaus entwickeln?

Die derzeitige Entwicklung deutet auf mehrere bedeutende Entwicklungen in der Technologie der Zeichenkonsistenz hin.

Video-Integration

Die Zeichenkonsistenz in Videos stellt die nächste Grenze dar. Laut Stable Diffusion Art unterstützt Hunyuan Video nun zum ersten Mal LoRA in großen Videomodellen. Dies ermöglicht konsistente Charaktere in Bewegung und eröffnet Möglichkeiten für KI-generierte Animation und Filmproduktion.

Die technische Herausforderung besteht darin, die zeitliche Kohärenz zu wahren, d. h. die Identität von Bild zu Bild aufrechtzuerhalten, während die Bewegung der Charaktere natürliche Posen- und Ausdrucksvariationen erzeugt. Zu den Lösungen gehören identitätserhaltende Adapter in Kombination mit bewegungssensitiven Architekturen, die verstehen, wie sich Gesichtszüge während der Animation verändern.

Generierung in Echtzeit

Verbesserungen der Verarbeitungsgeschwindigkeit ermöglichen die Konsistenz von Figuren in Echtzeit für interaktive Anwendungen. Zukünftige Implementierungen könnten die Live-Charaktergenerierung in Spielen, virtueller Realität oder interaktiven Geschichten unterstützen, bei denen die Auswahl des Benutzers das Aussehen und die Aktionen des Charakters bestimmt.

Multimodale Konsistenz

Die Ausweitung der Konsistenz über das visuelle Erscheinungsbild hinaus auf Stimme, Persönlichkeit und Verhaltensmuster schafft wirklich kohärente Charaktere. Durch die Integration von Sprachmodellen können Charaktere nicht nur ihre visuelle Identität bewahren, sondern auch eine konsistente Persönlichkeit in Gesprächen, bei Entscheidungen und im Verlauf der Geschichte.

Verbesserte Kontrolle der Feinheiten

Mit den Systemen der nächsten Generation können winzige Details wie spezifischer Schmuck, einzigartige Tätowierungen und Markenelemente besser erhalten werden, ohne dass die Gesamtidentität verloren geht. Dieser Fortschritt ermöglicht die Zeichenkonsistenz bei Anwendungen, die ein präzises visuelles Branding oder die Einhaltung von Markenzeichen erfordern.

Erfahrungsberichte: Echte Schöpfererfahrungen mit Zeichenkonsistenz

Benutzererfahrungen auf verschiedenen Plattformen liefern praktische Erkenntnisse, die über die technischen Spezifikationen hinausgehen.

Erfolgsgeschichte eines Spieleentwicklers

Ein Reddit-Benutzer hat die Konsistenz des Charakters Gemini untersucht, und das Ergebnis ist atemberaubend. Die Frau sieht nicht nur unglaublich realistisch aus, auch die Konsistenz ist erstaunlich.

Auf Instagram und anderen Plattformen werden bereits unzählige Fake-Profile erstellt. Die… pic.twitter.com/gtIMGJ2M8i

– Chubby♨️ (@kimmonismus) December 28, 2025

Ein Reddit-Nutzer untersuchte die Konsistenz der Charaktere von Gemini und stellte “atemberaubende” Ergebnisse mit realistischem Aussehen und überraschender Konsistenz fest. Der Entwickler hat eine komplette Besetzung für ein Indie-Spiel erstellt und berichtet, dass “jeder Charakter seine einzigartige Identität über Hunderte von Posen und Ausdrücke hinweg beibehält”

Marketing-Team Implementierung

Ein Marketingdirektor berichtete über AI Consistent Character:

“Wir verwenden jetzt einheitliche AI-Charaktere für alle unsere Kampagnen. Mit einem Fotoshooting haben wir unbegrenzte Variationsmöglichkeiten. Verschiedene Outfits, Einstellungen, Gesichtsausdrücke – alles perfekt aufeinander abgestimmt. Eine enorme Kosten- und Zeitersparnis!”

Perspektive eines Solokünstlers

Ein unabhängiger digitaler Künstler teilt:

“Als Solokünstler ist Consistent Character AI von unschätzbarem Wert. Ich entwerfe eine Figur einmal und kann sie dann in jeder beliebigen Pose oder mit jedem beliebigen Ausdruck darstellen. Durch die Zeitersparnis bei der Wahrung der Konsistenz kann ich mich auf das Geschichtenerzählen konzentrieren.”

Ersteller von Bildungsinhalten

Ein Pädagoge, der Unterrichtsmaterialien erstellt, wird darauf hingewiesen:

“Die Erstellung von Lerninhalten mit konsistenten Charakteren hält die Schüler bei der Stange. Unser KI-Lehrer taucht im Laufe des Kurses in verschiedenen Szenarien auf und sorgt so für perfekte Konsistenz. Die Studenten können sich besser mit bekannten Gesichtern identifizieren.”

Welche häufigen Fehler sollte ich vermeiden?

Die Erfahrung zeigt, dass häufige Fallstricke die Ergebnisse der Zeichenkonsistenz beeinträchtigen.

Inkonsistente Referenzbilder

Die Verwendung mehrerer Referenzbilder mit erheblichen Unterschieden in Bezug auf Beleuchtung, Winkel oder Qualität verwirrt die Identitätsextraktoren. Die KI versucht, widersprüchliche Informationen miteinander in Einklang zu bringen, was zu gemittelten Ergebnissen führt, die mit keiner einzigen Referenz übereinstimmen.

Lösung: Verwenden Sie eine einzige, qualitativ hochwertige, gleichmäßig beleuchtete, nach vorne gerichtete Referenz als Hauptanker. Fügen Sie nur dann zusätzliche Referenzen hinzu, wenn dies für bestimmte Blickwinkel erforderlich ist, und stellen Sie sicher, dass diese eindeutig dasselbe Zeichen zeigen.

Übermäßiger Rückgriff auf Schlüsselwörter

Die Erwartung, dass prompte Schlüsselwörter allein ohne Referenzbilder oder trainierte Modelle für Konsistenz sorgen, führt zu unzuverlässigen Ergebnissen. Allgemeine Beschreibungen wie “blonde Frau in rotem Kleid” führen jedes Mal zu unterschiedlichen Interpretationen.

Lösung: Verankern Sie die Konsistenz immer mit technischen Hilfsmitteln – Referenzparameter, Identitätsadapter oder LoRAs. Verwenden Sie Eingabeaufforderungen zur Angabe von Variablen (Pose, Umgebung, Beleuchtung), während die Werkzeuge die Identität wahren.

Unzureichende Tests

Die Erstellung eines einzigen erfolgreichen Bildes ist kein Garant für Konsistenz. Charaktere können in einem Szenario identisch erscheinen, aber in anderen dramatisch abweichen – insbesondere bei Posenänderungen, unterschiedlicher Beleuchtung oder Stilvariationen.

Die Lösung: Erzeugen Sie Testserien, die verschiedene Bedingungen abdecken: mehrere Blickwinkel (frontal, im Profil, aus drei Vierteln), verschiedene Beleuchtungen (hell, dunkel, dramatisch), unterschiedliche Ausdrücke und Stilrichtungen. Identifizieren Sie Fehlermuster, bevor Sie die Produktion in Angriff nehmen.

Plattform-Stärken ignorieren

Der Versuch, Midjourney für wissenschaftlichen Realismus oder Stable Diffusion für gelegentliche Experimente zu verwenden, führt zu einer Fehlanpassung der Fähigkeiten des Tools an die Projektanforderungen. Jede Plattform ist für unterschiedliche Anwendungsfälle optimiert.

Lösung: Passen Sie die Plattform an die Projektanforderungen an. Verwenden Sie referenzbasierte Systeme (Midjourney, OpenArt) für schnelle Iteration und Art Direction. Einsatz technischer Systeme (InstantID, LoRA) für präzise Kontrolle und Produktionsabläufe.

Definitionen: Technisches Glossar

- Charakter-Konsistenz: Die Fähigkeit, mehrere Bilder desselben Charakters zu generieren und dabei identische Gesichtszüge, Körperproportionen und eine erkennbare Identität in verschiedenen Posen, Lichtverhältnissen und Szenarien beizubehalten.

- LoRA (Low-Rank Adaptation): Eine Feinabstimmungstechnik, bei der kleine Adapterschichten auf eingefrorenen Basismodellen trainiert werden. Dabei werden kompakte Dateien (10-200 MB) erstellt, die die Ausgabe von Stable Diffusion so verändern, dass bestimmte Charaktere oder Stile konsistent erzeugt werden.

- InstantID: Ein Plug-and-Play-Identitätserhaltungssystem, das Gesichtscodierer und ControlNet verwendet, um das Erscheinungsbild von Charakteren in KI-generierten Bildern ohne Testzeit-Feinabstimmung beizubehalten, wobei nur ein einziges Referenzbild benötigt wird.

- IP-Adapter: Ein Adaptersystem, das Cross-Attention-Mechanismen verwendet, um Bildmerkmale in Text-Bild-Diffusionsmodelle einzubringen, was eine referenzbasierte Generierung ermöglicht und gleichzeitig ein Gleichgewicht zwischen Textsteuerung und visueller Wiedergabetreue schafft.

- ControlNet: Ein zusätzliches neuronales Netz, das die Bilderzeugung durch die Verarbeitung von Referenzbildern für Pose, Kanten, Tiefe oder andere kompositorische Elemente räumlich oder strukturell unterstützt.

- Zeichenreferenz (–cref): Ein Parameter in Midjourney, der die Gesichtszüge, Haare und Kleidung eines Referenzbildes analysiert und diese Merkmale dann auf neue Generationen anwendet, wobei Variationen der Szene und des Stils möglich sind.

- Charakter-Gewichtung (–cw): Ein numerischer Parameter (0-100), der steuert, wie streng die KI-Systeme den Referenzbildern folgen, wobei höhere Werte mehr Details bewahren und niedrigere Werte größere kreative Variationen erlauben.

- Trainingsdatensatz: Eine Sammlung von 15-50 kuratierten Bildern, die verwendet werden, um KI-Modellen durch LoRA-Feinabstimmung einen bestimmten Charakter beizubringen, wobei in der Regel verschiedene Posen, Ausdrücke, Blickwinkel und Lichtverhältnisse erforderlich sind.

- Identitätseinbettung: Eine mathematische Darstellung, die aus Gesichtserkennungsmodellen extrahiert wird und einzigartige Gesichtsmerkmale in einer kompakten Form erfasst, so dass KI-Systeme bestimmte Identitäten erkennen und reproduzieren können.

- Prompt-Engineering: Die Praxis der sorgfältigen Strukturierung von Textbeschreibungen zur Anleitung von KI-Bildgeneratoren, wobei konsistente Identitätsinformationen von variablen Szenenelementen getrennt werden, um eine optimale Zeichenkonsistenz zu gewährleisten.

FAQ: Beantwortete Fragen zur Zeichenkonsistenz

- F1: Inwiefern verbessert sich die Zeichenkonsistenz bei der Verwendung spezieller KI-Tools im Vergleich zu generischen Prompts?

Die Zeichenkonsistenz verbessert sich mit speziellen Werkzeugen erheblich, da sie technische Mechanismen einsetzen, die über die Textinterpretation hinausgehen. Allgemeine Eingabeaufforderungen beruhen ausschließlich auf dem Verständnis von Sprachmodellen, die jedes Mal probabilistische Variationen erzeugen. Spezielle Systeme verwenden Gesichtserkennungseinbettungen, räumliche Encoder und trainierte Adapter, die Identitätsmerkmale mathematisch erhalten. Forschungsergebnisse zeigen, dass referenzbasierte Systeme 85-95 % Ähnlichkeitsergebnisse erzielen, während reine Prompt-Ansätze nur 30-50 % erreichen. Tools wie InstantID und zeichenorientierte LoRAs bieten quantifizierbare Konsistenzverbesserungen, die durch FaceNet-Ähnlichkeitsmetriken messbar sind und sicherstellen, dass das gleiche Zeichen über Hunderte von Generationen hinweg erkennbar ist. - F2: Kann die Zeichenkonsistenz beibehalten werden, wenn sich der Zeichenstil drastisch ändert?

Die Konsistenz von Figuren bei dramatischen Stilwechseln (von fotorealistisch zu Anime, von Cartoon zu Ölgemälde) stellt eine große Herausforderung dar, ist aber mit den richtigen Techniken erreichbar. IP-Adapter zeigt eine überlegene Leistung bei Stilübertragungen, da CLIP-basierte Einbettungen eher abstrakte geometrische Merkmale als das Aussehen der Oberfläche erfassen. Der Arbeitsablauf sieht vor, dass zunächst eine Figur im Zielstil generiert wird, die dann als stilisierte Referenz für nachfolgende Bilder in der gleichen Ästhetik verwendet wird. OpenArt optimiert speziell die stilunabhängige Zeichenkonsistenz, so dass die Identität bei realistischen, Anime- und Cartoon-Stilen erhalten bleibt. Bei extremen Transformationen ist mit einer gewissen Identitätsabweichung zu rechnen – 75-85 % Konsistenz gegenüber 90 % innerhalb einzelner Stile. - F3: Welche Anforderungen an die Trainingsdaten stellen eine optimale Zeichenkonsistenz mit LoRA sicher?

Für eine optimale Zeichenkonsistenz mit LoRA sind 15-30 qualitativ hochwertige Bilder erforderlich, die verschiedene Blickwinkel, Ausdrücke und Posen zeigen. Qualität ist wichtiger als Quantität – weniger ausgezeichnete Bilder sind besser als große Datensätze mit geringer Vielfalt. Effektive Trainingsdaten umfassen Frontal-, Profil- und Dreiviertelansichten, neutrale, lächelnde und verschiedene emotionale Ausdrücke, unterschiedliche Lichtverhältnisse (weich, hell, dramatisch), mehrere Posen, wenn die Ganzkörperkonsistenz wichtig ist, einheitliche Kleidung oder vermerkte Outfitvariationen in den Bildunterschriften. Charakterbögen – Einzelbilder mit mehreren Posen – können in einzelne Übungsbeispiele unterteilt werden. Das Training auf einer RTX 4090 ist mit geeigneten Datensätzen in 1-2 Stunden abgeschlossen, während unzureichende oder homogene Daten unabhängig von der Trainingszeit zu inkonsistenten Ergebnissen führen. - F4: Wie geht die Technologie der Zeichenkonsistenz mit mehreren Charakteren in einzelnen Szenen um?

Die Zeichenkonsistenz bei mehreren Personen erfordert eine individuelle Identitätserhaltung für jede Person sowie kompositorische Kohärenz. Die zuverlässigste Methode trainiert separate LoRAs mit eindeutigen Auslösewörtern und kombiniert sie dann mit gewichteter Syntax in Prompts. Bei Plattformen wie Midjourney werden durch die Verkettung mehrerer Referenz-URLs mit--cref URL1 URL2die Zeicheninformationen gemischt, wobei frühere URLs einen stärkeren Einfluss erhalten. Fortgeschrittene Workflows verwenden regionale Eingabeaufforderungen oder Inpainting, um die Platzierung einzelner Zeichen zu steuern. Tests zeigen, dass die Beibehaltung von 2-3 Zeichen eine Erfolgsquote von 80-90 % bei der Konsistenz erreicht, während 4 Zeichen ohne sorgfältige Planung der Zusammensetzung auf 60-70 % sinken. Professionelle Arbeitsabläufe generieren die Zeichen separat und fügen sie dann mit Bildbearbeitungswerkzeugen zusammen, um eine maximale Kontrolle über komplexe Szenen mit mehreren Zeichen zu erhalten.

Nächste Schritte: Verbessern Sie Ihren kreativen Workflow

Die Zeichenkonsistenz stellt eine grundlegende Veränderung in der KI-gestützten Kreativproduktion dar. Ganz gleich, ob Sie Spiele entwickeln, fiktionale Serien veröffentlichen oder Markenkampagnen verwalten – die Beherrschung dieser Tools verbessert Ihre Fähigkeit, kohärente visuelle Erzählungen zu produzieren.

Beginnen Sie noch heute zu experimentieren: Wählen Sie die Plattform, die Ihren Anforderungen entspricht – Midjourney für schnelle Iteration, OpenArt für stilistische Vielseitigkeit oder Stable Diffusion mit LoRA für technische Kontrolle. Generieren Sie Testcharaktere, untersuchen Sie die Konsistenz verschiedener Szenarien und finden Sie heraus, welche Arbeitsabläufe Ihrer spezifischen kreativen Vision entsprechen.

Weitere fortgeschrittene Techniken, praktische Arbeitsabläufe und die neuesten Werkzeuge für die kreative Produktion finden Sie in Nowadais!

Last Updated on Januar 26, 2026 8:26 p.m. by Laszlo Szabo / NowadAIs | Published on Januar 25, 2026 by Laszlo Szabo / NowadAIs